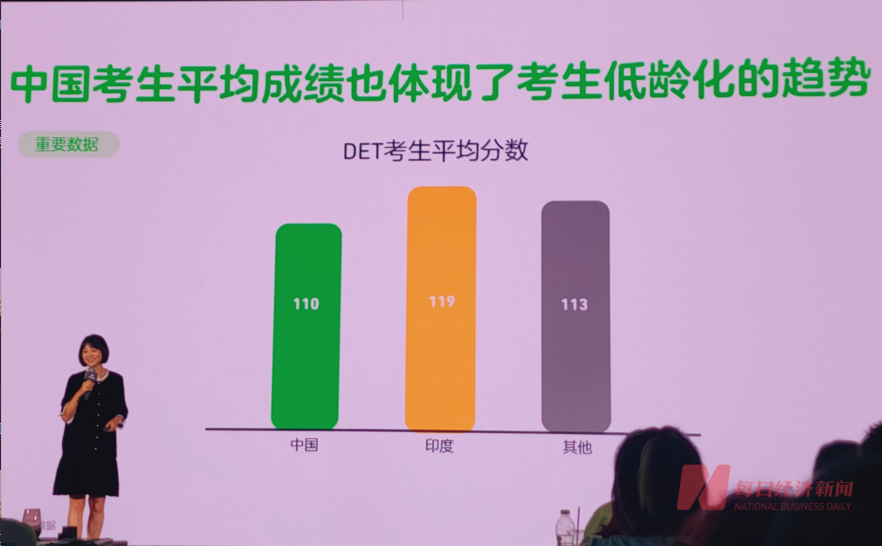

9月11日,生数科技举办媒体开放日活动,发布“主体参照”(Subject Consistency)功能,意在破解视频模型生成主体的“一致性”难题。

活动上,生数科技联合创始人、CEO唐家渝在回应《每日经济新闻》记者关于商业模式的提问时表示,目前行业内有SaaS(软件即服务)订阅和MaaS(模型即服务)两种,7月30日Vidu上线以来,在全球范围内已收到数万个API接入申请。

就底层架构,唐家渝表示旗下产品“VIDU”所用的“U-ViT架构”与Sora所用的“DiT架构”几乎一模一样,差别在于U-ViT作了更多面向落地的设计。在技术路线上,大家现在处于底层架构收敛的状态,但同质化并不代表大家所有进展、能力相同,唐家渝举例说:“例如现在的语言模型,(虽然)大家都使用Transformer架构,但从现实来看,OpenAI还是明显领先的。”

目前,AI视频的主要使用者还是专业用户,如电影工作者等,但唐家渝认为,AI视频已经来到了“普及”的节点。

此外,从当前阶段的收入来说,生数科技在B端市场获得的收入更多,C端的增长曲线则在Vidu产品上市这一个月以来非常“陡峭”。

唐家渝 图片来源:每经记者 李少婷 摄

“最终的目标还是做通用大模型”

唐家渝是清华大学自然语言处理实验室硕士,此前曾任瑞莱智慧副总裁、腾讯优图实验室高级产品经理等。唐家渝目前所在的生数科技于2023年3月成立,今年3月初宣布完成新一轮融资。今年4月底,该公司与清华大学联合研发的原创视频大模型Vidu面向全球发布,7月底正式上线,全面开放使用。

Vidu问世即被称为“中国版Sora”。这种称呼一方面是因为外界对中国视频大模型充满期待,另一方面,从技术架构上说,二者也有异曲同工之处。

据介绍,Vidu的底层基于自研的U-ViT架构,而Sora是基于DiT架构。关于U-ViT与DiT架构的区别,唐家渝介绍:“一句话总结来说,几乎一模一样。”二者都是Diffusion和Transformer的融合,甚至底层一些技术细节也是相同的。不同之处在于,U-ViT架构“做了更多面向落地的优化设计”,简单概括下来,就是在训练同一模型时,相同时间下,U-ViT所需的算力更少。

从整体的技术路线来看,当前国内几家视频大模型都走的是“类Sora路线”,那大家未来是否会愈加同质化?

对此,唐家渝介绍,当前大家是处于底层架构收敛的状态中,“但同质化并不代表大家所有进展、能力都相同”。他以语言模型为例分析道,大家都会使用Transformer架构,但从现实情况来看,OpenAI还是明显领先,这是因为在这一架构基础上仍有诸多环节需要技术技巧、实践经验帮助破解难点,这就导致了不同语言模型在能力上的差距。

当前,业内也在探索新的架构路线,例如将多模态的生成和多模态理解结合起来,但目前仍没有特别好的方案出现。

“我们最终的目标还是做通用大模型,视频生成是多模态生成大模型中间的一个阶段。”唐家渝坦承了开发通用大模型的雄心。

他还表示:“这并不意味着我们完全只在做这一个事情(指视频大模型),我们除了视频以外也有其他模态的生成能力。”

“目前B端市场收入更多”

技术底层逻辑的趋同,也或多或少低导致了市场开发思路相近。

“大家的商业选择上还是比较类似的,即便是像Sora、Runway,都在积极地拥抱好莱坞或者广告合作等方向。”唐家渝认为,AI生成视频领域总的来说还处在发展前期,国际头部玩家在齐头并进,或者叫“共同扩大市场”。

以生数科技为例,唐家渝将落地商业模式分为两个方向:其一是SaaS订阅模式,Vidu每个月有一些免费的额度,但是如果有更多的需求或想使用更高级的能力,就需要支付订阅费用,Vidu也会不断丰富产品功能,以满足用户的创作需求;其二是模型能力输出模式(MaaS),当前不少客户需要视频生成能力,以此作为工作流程的一个环节或者来衍生出有意思的玩法,这些客户希望可以直接调用模型。

从收入角度来看,B端市场在目前这个阶段获得的收入更多。不过Vidu上线一个月来,C端的增长曲线也非常“陡峭”。“我们目前判断下来的话,B端(的需求)是比较明确、比较直接和比较稳定的,所以B端是我们的一个长期、重点方向。C端我们也在不断探索。”唐家渝表示。

当前,国内的视频生成模型和工具已形成“出海潮”,并且表现亮眼,但唐家渝认为:“还不能说国内已经完全领先,国内外头部玩家都属于第一梯队。”

“AI视频来到了一个节点”

视频大模型的受众群体中,影视、动漫从业者居多,他们多被视为“专业受众”,那对“普通人”来说,AI视频何时能成为他们可以驾驭的工具?

唐家渝以摄影为例,从胶片机时代到手机摄影普及,就是一个不断降低创作者门槛的过程。“现在的AI视频来到了一个节点。”唐家渝介绍,9月11日,生数科技发布的“主体参照”功能,正是为降低创作者门槛或者加速创作过程所作的努力。

“技术仍是关键因素,目前的视频生成只是初步符合物理规律,还有很高的天花板需要突破,比如更强的模型能力以及更多模态的协同生成。”唐家渝介绍,这次发布的“主体参照”能力在一致性生成方面确实有了很大提升,但是还有很多地方需要进一步提升。“例如要大模型从生成一个商品变成生成一个工艺品,而这个工艺品上面有繁复花纹和镂空部分,面对如此复杂的结构,目前的生成成功率依旧不高。场景生成包含很多组成因素,例如运动鞋,我就希望它能在更复杂、更动态化的场景中有更好的表现。这些都需要不断提升模型能力。”

这个过程中,技术的原创性和突破性需要与良好的商业化齐头并进,因为商业公司毕竟不是科研机构。

以视频生成的时长为例,拓展生成时长需要提升模型对世界抽象理解的能力、信息压缩和放大的双向能力。当前Vidu最长可以生成32秒的视频,生数科技计划将其扩展得更长,不过,时长还不是生数科技现在重点产品化的部分。

“在实际创作中,粗略地来说,90%以上的片段都是几秒钟。因此,从实用角度来看,我们还没有将时长作为我们的优先发布考虑。”唐家渝强调,但从模型能力角度,公司实际上在持续提升。

京公网安备

11010202010575号

京公网安备

11010202010575号

加载中,请稍侯......

加载中,请稍侯......